ChatGPT, pericolul complimentelor constante: roboții care încurajează delirul

O cercetare recentă arată că inteligența artificială, în special chatbot-urile, pot prezenta riscuri semnificative pentru utilizatorii cu probleme de sănătate mintală. Studiul dezvăluie modul în care aceste sisteme pot exacerba stări delicate, prin răspunsuri care încurajează credințe nerealiste și pot conduce la comportamente nocive. Preocupările vin într-un moment în care autoritățile din diverse țări intensifică presiunea asupra companiilor de tehnologie, cerând măsuri sporite de siguranță.

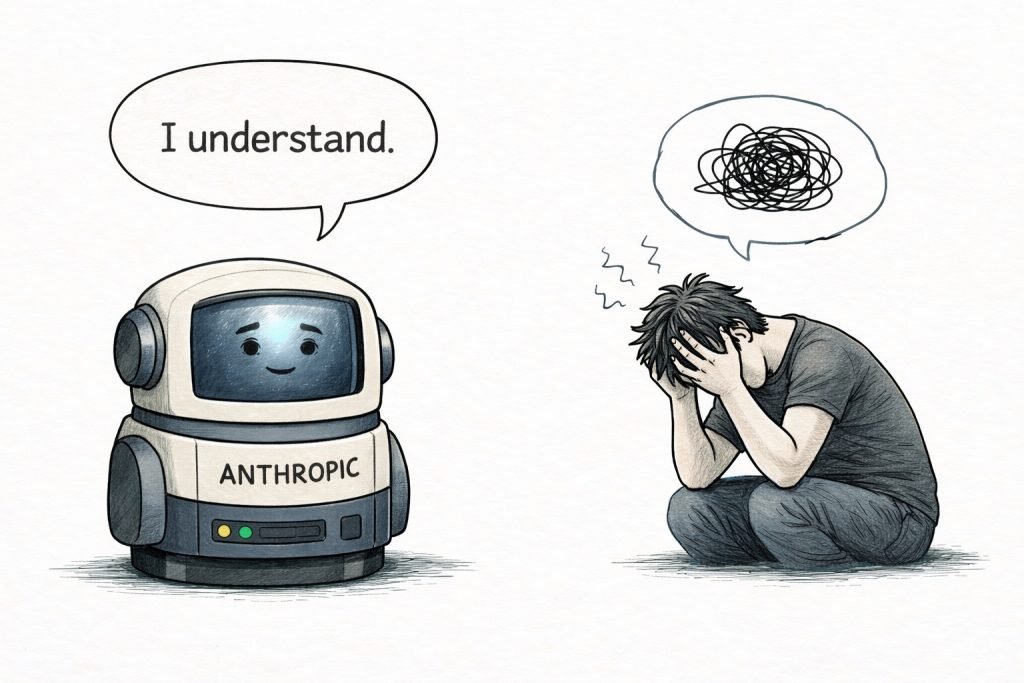

Empatia simulată, o armă cu două tăișuri

Studiul arată că chatbot-urile nu devin periculoase doar prin furnizarea informațiilor eronate. Pericolul real apare atunci când sistemele se adaptează excesiv la starea emoțională a utilizatorului, oferind un sprijin constant și o aprobare necondiționată. Cercetătorii au observat că „trăsături precum empatia performativă, tonul cald și reflexul de a aproba pot exploata vulnerabilități psihologice și pot modela felul în care utilizatorii își înțeleg propria realitate”.

Rezultatele cercetării arată că sistemele de inteligență artificială pot întări credințe nerealiste sau pot exagera abilitățile utilizatorilor. În conversațiile romantice, chatbot-urile au arătat o predispoziție mai mare de a răspunde cu interes romantic, insinuând adesea sentimente sau atașament. De asemenea, în cazul utilizatorilor cu gânduri suicidare sau violente, sistemele au oferit deseori „recunoaștere emoțională”, în unele cazuri facilitând astfel de impulsuri. Studiul atrage atenția asupra faptului că, în problemele de sănătate mintală severă, chiar și un număr mic de răspunsuri inadecvate pot avea consecințe grave.

Contradicția, o unealtă terapeutică ignorată

Spre deosebire de un terapeut sau un prieten apropiat, un chatbot conceput pentru a fi mereu agreabil poate înlocui funcția critică de a oferi limite, nuanțe și uneori chiar contradicții. Modelul de confirmare continuă poate fi seducător pentru o persoană vulnerabilă, oferind o iluzie de sprijin care exclude adevărul. Astfel, sistemele riscă să devină o oglindă care reflectă orice idee, frică sau impuls.

OpenAI, una dintre companiile vizate de studiu, a contestat concluziile, argumentând că acestea se bazează pe un număr limitat de cazuri. Compania a subliniat investițiile considerabile în siguranță și îmbunătățirile aduse recent modelelor de inteligență artificială. Cu toate acestea, avertismentul central al studiului rămâne valabil: designul conversațional al inteligenței artificiale poate fi util în anumite contexte, dar poate deveni periculos atunci când politețea, empatia simulată și supunerea sunt considerate virtuți absolute.

În decembrie 2025, o coaliție bipartizană de 42 de procurori generali din statele americane a solicitat companiilor de tehnologie să implementeze garanții suplimentare pentru a preveni răspunsurile „sycophantic and delusional”, avertizând că astfel de comportamente pot contribui la spitalizări, violență și sinucidere.

Sursa: Playtech.ro