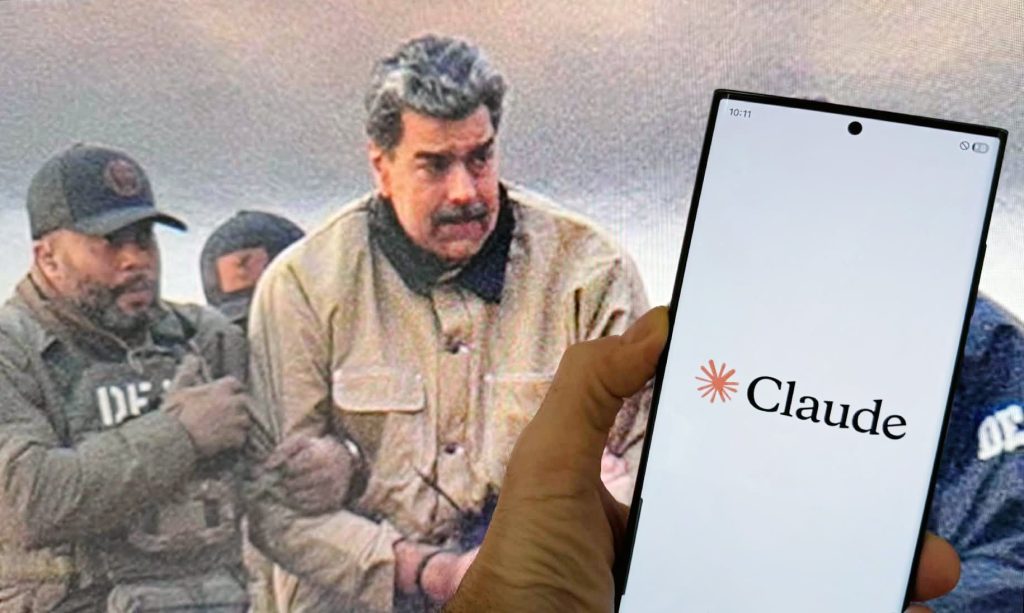

Armata SUA, acționând cu inteligență artificială avansată, în spatele unei operațiuni de amploare împotriva lui Nicolás Maduro

Recent, o informație șocantă a ieșit la iveală: armata americană ar fi folosit un model de inteligență artificială (AI) dezvoltat de compania Anthropic, numit Claude, într-o operațiune clandestină din Venezuela, care a dus la arestarea liderului autoritar Nicolás Maduro. Conform unui raport preluat de Reuters din The Wall Street Journal, aceste tehnologii de ultimă generație ar fi fost implicate printr-un parteneriat între Anthropic și firma de analiză de date Palantir, ale cărei platforme sunt utilizate pe scară largă de Pentagon și alte agenții federale. Deși aceste afirmații nu au fost încă confirmate independent, ele ridică semne de întrebare cu privire la modul în care AI-ul ajunge în zone extrem de sensibile, inclusiv în operațiuni secretizate de securitate națională.

Infiltrarea AI-ului în strategiile militare și rolul Palantir

Se pare că modelul Claude a fost integrat în infrastructura militară americană prin intermediul platformei Palantir, o companie cunoscută pentru soluțiile sale de analiză a datelor pentru departamente de securitate și intelligence. Această integrare ar fi permis forțelor militare să utilizeze chiar și modele de AI comerciale în medii clasificate, fără a fi nevoie de modificări majore sau de un proces de autorizare complicat. În esență, Palantir pare să fi creat o „ușă laterală” pentru Claude, facilitând utilizarea sa în contexte unde controalele și reguli stricte sunt de obicei obligatorii, dar pot fi evitate în anumite condiții.

Această metodă nu este doar o soluție tehnică, ci și un semnal pentru industria de AI și pentru guverne: pot fi exploatate soluții comerciale și neclasificate pentru operațiuni de securitate națională, chiar și în condițiile în care regulile interne impuse de dezvoltatori, precum Anthropic, interzic utilizarea pentru sprijinirea violenței sau supravegherii ilegale.

Presiuni asupra companiilor de AI pentru acces în rețelele clasificate

Pe fondul acestei situații, sursele indică faptul că Pentagonul face eforturi pentru a-i convinge pe marii dezvoltatori de AI, precum OpenAI și Anthropic, să permită accesul extins pe rețelele guvernamentale clasificate, cu reguli mai permisive decât cele aplicate publicului larg. Scopul este clar: dorința de a avea la dispoziție modele de AI foarte puternice, capabile să analizeze volume imense de date, într-un timp foarte scurt, pentru decizii militare sau de siguranță națională.

Această tendință ridică o serie de întrebări privind controlul și securitatea tehnologiei. În condițiile în care AI-ul devine un instrument esențial pentru operațiuni secrete, riscurile de abuz, de scurgere de informații sau de utilizare în scopuri neautorizate devin încă mai acutizate.

Dilema etică și consecințele implicării AI în acțiuni militare

Cea mai controversată problemă revine la utilizarea AI într-o orchestrare a operațiunilor cu implicații politice și juridice de amploare. Politicile companiei Anthropic interzic explicit utilizarea modelului Claude pentru a sprijini acțiuni violente, pentru proiectarea armelor sau monitorizarea ilegală. Însă, dacă aceste afirmații se confirmă, devine dificil să se stabilească unde se termină analiza și unde începe implicarea în acțiuni de forță.

În cazul divulgării despre Maduro, partea implicată susține că liderul venezuelean a fost transportat în New York pentru a răspunde acuzațiilor legate de trafic de droguri. Însă, dacă această operațiune a fost gestionată cu ajutorul AI-ului, întrebările legate de legalitate și de responsabilitate devin tot mai stringente. Într-un moment în care tehnologia avansează rapid și regulile de utilizare sunt în continuă definire, riscul de precedent periculos nu poate fi ignorat.

Deocamdată, reacțiile oficiale din partea Pentagonului, companiei Anthropic sau a Palantir continuă să lipsescă sau să fie evazive. Dar riscurile și implicațiile acestei conjuncturi sunt tot mai clare: dacă AI-ul ajunge să fie folosit pentru operațiuni secrete, o nouă eră a securității naționale se naște, cu toate dilemele etice și politice pe care le implică. Situația devine, astfel, un test major pentru modul în care lumea modernă va gestiona echilibrul între inovație, securitate și responsabilitate.