America devine tot mai implicată în controverse legate de utilizarea inteligenței artificiale în domeniul militar

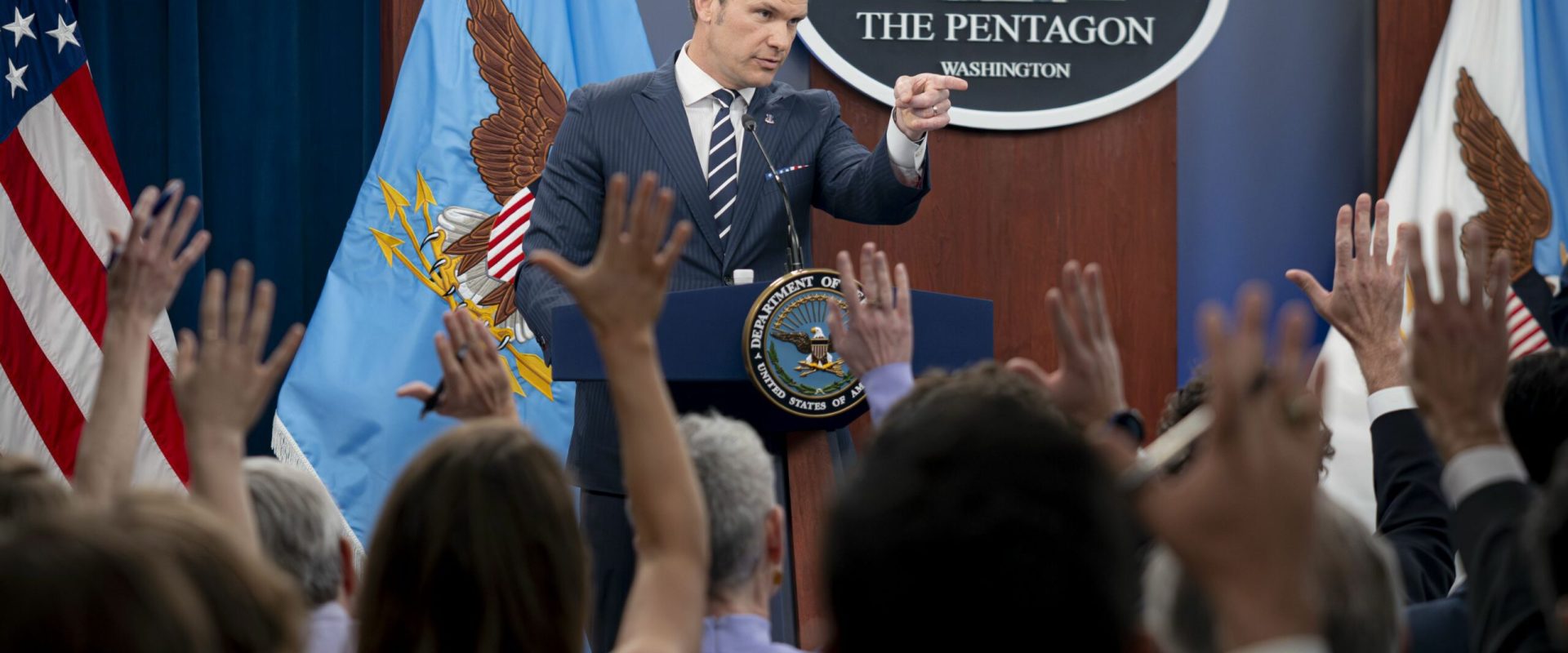

Departamentul american al Apărării se află în epicentrul unei dispute tensionate cu o companie privată specializată în dezvoltarea de tehnologii AI, după ce a fost emis un termen limită pentru modificarea restricțiilor asupra unui model de inteligență artificială folosit în scop militar. Potrivit surselor apropiate cazului, secretarul american al Apărării, Pete Hegseth, le-a transmis angajaților companiei Anthropic că, până vineri, aceștia trebuie să permită utilizarea completă a AI-ului lor, Claude, pentru toate scopurile legale în domeniul apărării naționale.

Această decizie vine într-un context în care Pentagonul are în derulare un contract valoric de 200 de milioane de dolari cu Anthropic, destinat utilizării AI în diferite operațiuni militare sau strategice. Însă, compania se află sub presiune și în fața unor restricții stricte impuse de propriile politici, care limitează modul în care AI-ul Claude poate fi utilizat, mai ales în domeniul militar. Pentagonul dorește ca modelul AI să fie disponibil pentru oricare utilizare legală, o condiție critică pentru aplicații precum drone autonome, analize de securitate sau alte echipamente de război modern.

Pe lângă presiunea economică și contractuală, se pare că implicarea forțelor americane în această dispută va avea și implicații legale, în cazul în care Anthropic refuză să-și ridice restricțiile. Sursele spun că, în situația în care compania nu va respecta termenul limită, Departamentul american al Apărării ar putea invoca “Legea producției de apărare”. Aceasta le permite autorităților să oblige întreprinderile private să producă echipamente și tehnologii necesare pentru securitatea națională, indiferent de acordul sau preferințele companiilor.

Îngrijorări privind utilizarea AI în arme și supraveghere

Un obstacol major în atingerea unui compromis îl reprezintă poziția precaută a Anthropic vis-à-vis de utilizarea AI-ului în domenii sensibile. Compania manifestă o preocupare justificată pentru implicațiile tale despre arme autonome și supraveghere în masă, teme ce generează dezbateri aprinse atât în cercurile de specialitate, cât și în media generală.

Potrivit aceleiași surse, Anthropic consideră că modelul Claude nu este încă absolut fiabil pentru operarea armamentului, iar lipsa reglementărilor clare în domeniul AI de supraveghere creează riscuri enorme. “Armele controlate de AI și supravegherea în masă a cetățenilor americani sunt două aspecte pe care nu vrem să le abandonăm”, a spus o persoană apropiată companiei, evidențiind distanța anumitor jucători din sectorul tehnologic față de politicile guvernamentale.

Controverse și implicații globale

Disputa recentă nu este un caz singular, ci face parte dintr-un trend mai larg de responsabilizare asupra utilizării AI în domeniul apărării. În ultimele luni, niciunul dintre cele mai mari actori din tehnologie, inclusiv compania Amazon sau Microsoft, nu și-au exprimat public intenția de a compromite standardele etice pentru câștiguri rapide în sectorul militar. Totuși, interesul pentru utilizarea AI în situații de conflict sporește vertiginos, ceea ce face ca aceste discuții să fie din ce în ce mai acută.

În plus, există informații că Pentagonul a utilizat deja modelul Claude în operațiuni delicate, inclusiv în timpul manevrelor de capturare a fostului lider venezuelean Nicolás Maduro. Deși nu sunt oficiale, aceste relatări intensifică dezbaterile despre rolul și limitele AI în război, precum și despre riscurile implicate.

Pe măsură ce termenul limită se apropie, viitorul relației dintre guvernul american și compania Anthropic rămâne incert. În timp ce oficialii militari insistă că tehnologia trebuie să fie adaptată nevoilor naționale, preocupările cu privire la etica și siguranța AI continuă să pună în balanță avantajele și riscurile utilizării acestor tehnologii în campanii militare. Rămâne de văzut dacă Anthropic va accepta să-și modifice poziția sau dacă va risca pierderea unui contract de o importanță strategică pentru Statele Unite.

Fii primul care comentează