Autoritatea olandeză pentru protecția datelor a avertizat cetățenii să nu ceară recomandări de vot de la chatbot-urile cu inteligență artificială înainte de alegerile generale ce vor avea loc în țară săptămâna viitoare, conform unei publicații online de știri.

Ei au subliniat că astfel de asistenți virtuali oferă o perspectivă limitată și extrem de polarizată asupra scenei politice din Olanda, considerând că testarea lor a evidențiat distorsiuni semnificative.

Reprezentanții autorității au recomandat alegătorilor să nu se bazeze pe sfaturi de vot provenite de la aceste sisteme, deoarece modul lor de funcționare nu este clar sau verificabil. Vicepreședinta instituției, Monique Verdier, a făcut un apel către dezvoltatorii de astfel de tehnologii pentru a preveni utilizarea lor în scopul oferirii de recomandări electorale.

Pentru a evalua modul în care partidele politice erau prezentate de aceste chatboti, autoritatea a realizat un experiment în care a creat profiluri care reprezentau diferite opțiuni politice din Olanda. Acestea au fost bazate pe instrumente locale de verificare a votului, iar apoi chatbot-urilor le-a fost cerut să dea sfaturi pentru aceste profiluri.

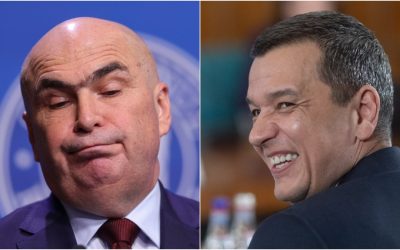

Rezultatele au arătat că utilizatorii cu preferințe de stânga și progresiste au fost direcționați în principal spre partidul ecologist și de lucru, condus de un fost vicepreședinte al Comisiei Europene, în timp ce cei de dreapta și conservatori au fost ghidați către partidul extrem de drept, condus de un politician aflat în vârful sondajelor.

Partidele din centru au avut o reprezentare redusă în recomandări, deși au fost similare în profilurile create pentru experiment.

De asemenea, companiile mari de tehnologie, precum OpenAI, Google și Mistral, au semnat un angajament de respectare a codului de practică al Uniunii Europene pentru cele mai avansate modele de inteligență artificială, asumându-și responsabilitatea pentru gestionarea riscurilor asociate, inclusiv cele legate de drepturile fundamentale și impactul asupra societății.

Fii primul care comentează